(来源:用友)

企业拥有海量数据,但数据不等于知识。ERP中的表、文档中的规则、流程中的约束——都藏在“人脑”和“文本”中,无法被机器直接理解。没有可计算的知识,AI只能靠概率“猜测”,无法用逻辑“保证”。

LOM本体大模型的核心能力之一,是自主构建企业业务的逻辑框架——从混沌数据中提炼出实体、关系、约束,形式化为可计算的本体。本文基于用友AI Lab全新发布的LOM本体大模型论文《Unifying Ontology Construction and Semantic Alignment for Deterministic Enterprise Reasoning at Scale》,深度解读这一能力,揭示LOM本体大模型如何为企业AI规模化奠定第一块基石。

01

企业AI规模化的坎:

数据不等于知识

过去十年,企业完成了大规模的数字化迁移。ERP、CRM、SCM、HRM——各类业务系统积累了海量数据。然而,当企业试图用AI处理这些数据时,一个根本问题浮出水面:数据不等于知识。

一个典型的ERP系统可能包含数百张表、数千个字段。字段名如“INV01”“CUST_TYPE”只是标识符,其业务含义需要人工解读;同一概念在不同系统中使用不同名称;业务规则藏在操作手册里,写在审批流程中,甚至存在业务专家的脑子里。

这种“数据丰富、知识贫乏”的困境,构成了企业AI规模化应用的第一道坎。没有可计算的知识框架,AI只能基于统计相关性进行“猜测”——这恰恰是概率模型的本质局限。

论文开篇即点明这一困境:“企业积累了海量数据,但其中大部分仍然混乱且实际上处于休眠状态。”如何唤醒这些沉睡的数据?答案在于自主构建。

02

本体:

让机器理解业务的“逻辑框架”

在人工智能领域,“本体”是一个基础概念。简单来说,本体是对一个领域的概念化——它定义了:

实体:业务中有哪些事物(供应商、物料、仓库、订单)

关系:这些事物之间如何关联(供应商提供物料、物料存入仓库)

约束:这些关系必须遵守什么规则(物料必须在保质期内、供应商必须通过资质审核)

我们可以把本体理解为企业的“业务物理定律”。正如牛顿定律描述了宇宙中物体的运动规律,本体描述了企业业务的运行逻辑。有了这套“定律”,机器就不再是盲目地“猜”,而是有章可循地“推”。

论文将这一思想总结为:通过自主构建本体,LOM本体大模型“创造了一个确定性的环境,其中逻辑不仅仅是概率性的,而是结构性的、具有约束力的”。

03

自主构建:

LOM如何从混沌数据中“提炼”逻辑框架

LOM本体大模型的自主构建能力,体现在它能够从

两类原始数据中自动抽取知识:

从结构化数据中发现隐式关系

企业数据库中的表常常缺少明确的外键定义。两个表之间是否存在关联,隐藏在数据本身之中。

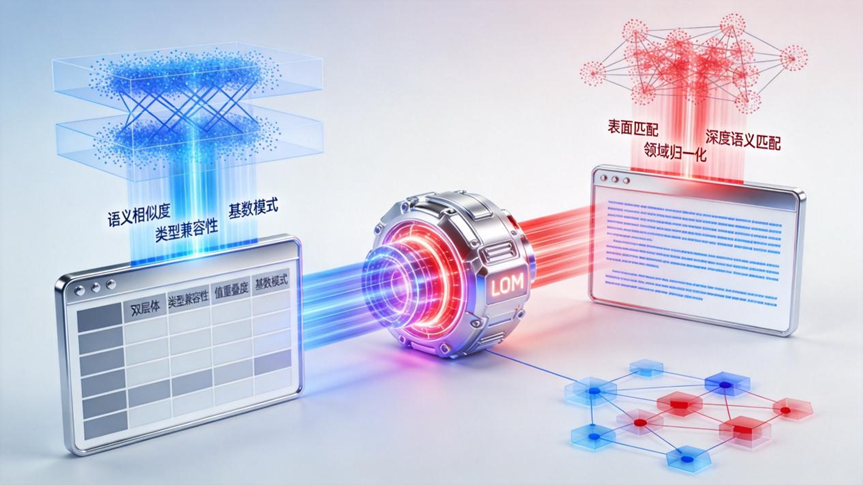

LOM本体大模型采用多因子置信函数来量化这种隐式关系,综合四个维度:

语义相似度:字段名称是否表达相似含义(如“supplier_id”与“vendor_code”)

类型兼容性:字段的数据类型是否匹配

值重叠度:字段中的实际值是否有共同部分

基数模式:值的分布是否符合一对多、多对一等关系特征

当综合置信度超过阈值,LOM本体大模型就在两个表之间建立关联。通过这种方式,LOM本体大模型能够发现那些“本该有外键却缺失”的隐含关系,构建出双层的“模式层-实例层”本体。

从非结构化文本中抽取实体与关系

企业的知识不仅存在于数据库中,更大量沉淀在文档里——操作手册、合同条款、政策文件、会议纪要。

LOM本体大模型采用LLM驱动的抽取管道:将文档分块处理,在低温度设置下执行实体-关系抽取,识别出业务实体及其属性,以及实体之间的关联类型(如“隶属于”“关联于”“属于”)。

抽取出的实体往往存在指代不一的问题——同一家供应商可能被称为“XX科技”“XX科技有限公司”“XX科技股份”。LOM本体大模型通过三层消歧规则解决这一难题:

表面匹配(编辑距离、子串包含)

领域归一化(标准化缩写与全称)

深度语义匹配(向量嵌入相似度)

最终,同一实体被合并为规范节点,形成文本层本体。

跨源融合:统一的企业知识图谱

结构化本体与文本本体并非彼此孤立。LOM本体大模型通过启发式标签匹配,将文本层实体锚定到结构化层的具体表或记录上,实现两类知识的深度融合。

融合后的企业本体是一个统一的异构图,既包含关系数据库的严谨结构,又承载非结构化文档的丰富语义。论文指出,这一过程“将原始数据中固有的概率噪声坍缩为确定性的结构表示”。

04

动态演化:

逻辑框架不是静态的,而是“活”的

企业的业务不是一成不变的。新供应商入库,新政策发布,新约束生效——逻辑框架必须随之演化。

传统方法每次更新都需要重新构建,成本高昂且滞后严重。LOM本体大模型则通过动态更新机制,支持本体的实时演化。论文将这一机制描述为“让图结构响应实时数据流入而动态适应”。

具体而言,LOM本体大模型将企业环境概念化为一个稀疏图,节点代表实体,边代表关系。当新数据流入,模型通过链接预测判断是否需要更新图状态——是否存在新节点?新关系?旧关系是否失效?然后递归更新图结构,保持与业务现实同步。

论文用公式描述了这一过程:Gₜ₊₁ = Update(Gₜ, ΔDₜ; θ_align)。这意味着,LOM的逻辑框架不是静态的“知识库”,而是动态的“生命体”,持续与业务现实同频共振。

05

逻辑框架如何服务于确定性推理

有了这个自主构建的逻辑框架,LOM本体大模型的推理不再是概率性的“猜测”,而是确定性的“推导”。

在传统的GraphRAG范式中,图被用作检索索引,帮助LLM定位相关文本,但最终推理仍由LLM的概率引擎完成。LOM本体大模型则完全不同——它将本体作为逻辑定律,在本体上直接执行确定的图算法(如最短路径、最小生成树)或逻辑规则推理。

论文强调:“只要本体正确,推理结果就是数学上必然的。”这正是7D逻辑自治的核心:结论不是“猜”出来的,而是由逻辑框架严格推导出来的。

这一转变对企业决策具有根本意义。当AI建议“更换供应商A”时,企业需要知道:这是基于什么规则?推导路径是什么?是否可验证、可追溯?LOM本体大模型的逻辑框架提供了所有这些答案。

论文的实验数据验证了这一路径的有效性:在链接预测任务(本体构建的核心)上,LOM-4B达到88.8%准确率。这证明LOM能够从真实企业的噪声数据中,准确地构建出可计算的逻辑框架。

从混沌数据到逻辑框架,LOM本体大模型的本体自主构建能力完成了企业AI规模化的关键一跃。它解决了“数据不等于知识”的根本困境,将企业散落的隐性知识转化为可计算的逻辑体系。

这个自主构建并持续演化的逻辑框架,正是后续语义对齐和确定性推理赖以实现的基石。没有它,AI只能“猜”;有了它,AI才能“推”。让AI获得“理解”业务世界逻辑的能力,是超越概率猜测、实现企业级确定性智能的必经之路。

LOM本体大模型论文地址,免费下载:

https://chinaxiv.org/abs/202603.00072

>>>查看更多:股市要闻